Bakgrunnen for spørsmålet var todelt. For det første krever føderert læring at alle involverte har de samme datapunktene i det samme formatet, og Finterai ønsket å drøfte hvor stort handlingsrom de har for å legge til rette for en slik standardisering uten å ta på seg behandlingsansvar.

Behandlingsansvar

Personvernforordningen benytter begrepene behandlingsansvarlig i

artikkel 4 nr. 7, databehandler i artikkel 4 nr. 8 og felles behandlingsansvarlige i artikkel 26 for å plassere ansvaret for å

følge reglene. Av ansvarlighetsprinsippet går det frem at hovedansvaret for å sikre at behandlingen av personopplysninger er i tråd med personvernforordningen ligger hos den behandlingsansvarlige.

En behandlingsansvarlig er den som utøver avgjørende innflytelse på

formålene med (dvs. hvorfor) og midlene for (dvs. hvordan) behandlingen

av personopplysninger, mens en databehandler behandler personopplysninger på vegne av den behandlingsansvarlige. Felles

behandlingsansvar inntrer hvor partene i fellesskap fastsetter formålene med og midlene for behandlingen av personopplysninger.

Les mer om hva en behandlingsansvarlig er

For det andre er det en viss mulighet for at modellene inneholder personopplysninger. Finterai ønsket derfor å drøfte hvilke konsekvenser dette kan få for dem når de skal kvalitetssikre modellene.

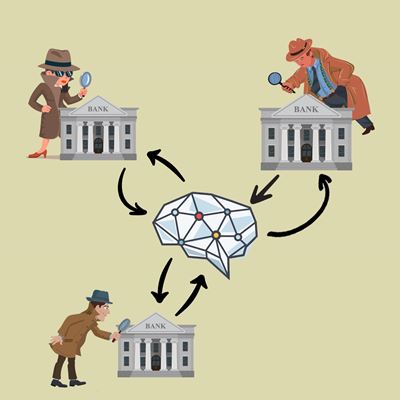

I sandkassen identifiserte vi i fellesskap ulike behandlinger av personopplysninger som skjer i, eller forutsettes av, løsningen til Finterai. Vi valgte ut tre forskjellige behandlingsaktiviteter som vi skulle se nærmere på:

- Standardisering av transaksjonsdata

- Innhenting av tredjepartsdata

- Kontroll av sårbarheter i modellene

Vi valgte å se nærmere på disse behandlingsaktivitetene fordi de er sentrale

behandlinger i, eller er forutsatt av, Finterais løsning, og fordi det er behandlinger som også er relevante for sammenlignbare virksomheter eller pliktsubjekter under hvitvaskingsloven.

Datatilsynet har ikke konkludert om hvilken rolle henholdsvis Finterai og bankene har i tilknytning til de tre utvalgte behandlingsaktivitetene. Dette er fordi vi ikke har tatt stilling til hva som eventuelt vil være rettslig grunnlag for Finterais eller bankenes behandling av personopplysninger. Diskusjonene i sandkassen har derfor i hovedsak handlet om hva som er relevante momenter i vurderingen av roller på bakgrunn av konkrete behandlingsaktiviteter, og hvilken retning de ulike momentene trekker i. Vi understreker at Datatilsynets vurderinger av roller kun er veiledende. Finterai og bankene må selv ta stilling til sin egen rolle basert på alle faktiske forhold.

1. Standardisering av transaksjonsdata

For at bankenes lokale data skal være kompatible med Finterais løsning for føderert læring, må dataene standardiseres og struktureres før de kan tas i bruk. Finterai tilbyr bankene programvare for standardisering som bruker kunstig intelligensdrevet, naturlig språkprosessering. Hensikten med denne programvaren er å standardisere data, herunder SWIFT-meldinger, slik at de er i samme format som tilsvarende data i andre banker, som også vil være med på den fødererte læringen.

I sandkassen har vi diskutert roller i tilknytning til standardisering av SWIFT-meldinger. Momentene i vurderingen er imidlertid relevante også for vurdering av roller ved standardisering av andre kategorier data, som for eksempel KYC-opplysninger og tredjepartsdata.

Det mest aktuelle formålet med å standardisere data i denne sammenhengen, vil være å tilpasse formatet på dataene, slik at de kan anvendes i føderert læring på tvers av bankene som deltar i samarbeidet. Det er den enkelte bank som selv bestemmer om de vil benytte Finterais tjeneste for føderert læring. Videre er det også bankene selv som bestemmer hvilken metode de vil benytte for å konvertere dataene til formatet som kreves for å kunne delta. Det er altså ikke et krav at de må benytte akkurat Finterais programvare for standardisering.

Videre skal programvaren installeres og kjøres i bankens eget IT-miljø, uten at Finterai eller de andre involverte bankene har tilgang på dataene som standardiseres. Trening av algoritmene i programvaren skal også skje internt hos den enkelte bank, og det er banken selv som har ansvar for dette. Resultatet av treningen skal ikke deles med Finterai eller de andre bankene som benytter samme programvare.

Momentene som er trukket frem ovenfor tilsier at den enkelte bank selv har avgjørende innflytelse både på beslutningen om å ta i bruk føderert læring som ledd i deres anti-hvitvaskingsarbeid, og hvilke midler de skal bruke for å oppnå formålet.

I diskusjonene i sandkassen har vi ikke identifisert noen formål knyttet til bankenes bruk av programvaren for standardisering, der Finterai har avgjørende innflytelse. Finterai skal som nevnt heller ikke få tilgang til personopplysningene som behandles av bankene, eller resultatet av behandlingen (standardiserte opplysninger eller læringen fra kunstig intelligens-drevet naturlig språkprosessering).

På bakgrunn av dette vurderer Datatilsynet det som lite sannsynlig at Finterai har avgjørende innflytelse på formålet eller midler til behandlingen. Finterai vil i så fall ikke få status som behandlingsansvarlig. Dersom Finterai ikke behandler personopplysninger på vegne av bankene, vil de heller ikke få status som databehandler.

2. Innhenting av tredjepartsdata

Det er ikke bare dataenes format som må være likt på tvers av aktører som vil bruke føderert læring, men også datakategoriene som benyttes. Dette er for at bankene skal ha tilgang på samme type data, og at inngående data skal kunne tolkes av modellen.

For å sikre at alle bankene som benytter tjenesten har tilgang på de samme data-kategoriene, må Finterai sette rammer for hvilke typer data som kan benyttes i systemet for føderert læring. I tillegg til data fra SWIFT-meldinger og KYC-data, som innhentes fra kundene og eventuelt transaksjonsmotpartene, krever Finterai at bankene innhenter det de kaller tredjepartsdata. Disse vil ofte inneholde personopplysninger.

I sandkassen har vi diskutert hvilken konsekvens det kan få for Finterais rolle at de definerer datakategoriene som deltagerne i den fødererte læringen må ha tilgang på. Vi har lagt til grunn at bankene allerede er i besittelse av SWIFT-meldingene og KYC-data. Diskusjonene har derfor primært knyttet seg til innhenting av tredjepartsdata.

Formålet med standardiseringen er å sikre at de deltagende bankene har tilgang på samme type data. Det er imidlertid et annet formål som er avgjørende for valget av datakategoriene, nemlig at bankene skal kunne bygge og trene modeller som er godt egnet for å avdekke mistenkelige transaksjoner.

Det er bankene som er ansvarlig for å overholde hvitvaskingsreglene. Finterai har ikke noe selvstendig ansvar etter dette regelverket. Som drøftet i avsnittene om standardisering av transaksjonsdata, er det bankene selv som har avgjørende innflytelse på om de som ledd i sitt anti-hvitvaskingsarbeid vil ta i bruk Finterais løsning for føderert læring. Det er ikke et krav at bankene må benytte Finterais programvare for innhenting av tredjepartsdata.

Den enkelte bank bestemmer selv om de vil ta i bruk Finterais tjeneste og dermed hvilke kategorier tredjepartsdata de følgelig må innhente, samt hvilken metode de vil benytte for å innhente dataene. Dersom den enkelte bank er uenig med Finterai om hvilke datakategorier som er nødvendig å innhente til formålet, kan banken velge bort Finterais løsning som ledd i deres anti-hvitvaskingsarbeid. Med andre ord kan det argumenteres for at den enkelte bank har avgjørende innflytelse på hvilke midler som skal brukes for å oppnå formålet.

Datakategorier kan sies å være essensielle midler (hvilke og hvem sine personopplysninger som skal innhentes), eller ‘kjernen’ i hvordan formålet skal oppnås. Videre skal ikke dataene deles med Finterai. Hvem som har avgjørende innflytelse på hvilke kategorier tredjepartsopplysninger som skal innhentes (midler) for å kunne trene modellene som er godt egnet for å avdekke mistenkelige transaksjoner (formål), er et viktig moment i vurderingen av roller.

Momentene som er trukket frem ovenfor, tilsier at det er den enkelte bank selv som har avgjørende innflytelse på formål og midler knyttet til innhenting av tredjepartsdata. Vi har imidlertid også sett på eventuelle egeninteresser som Finterai kan ha knyttet til beslutningen om hvilke data kategorier som skal benyttes i løsningen.

I vurderingen av roller ved standardisering av transaksjonsdata, la vi vekt på at Finterai hverken skal ha tilgang på personopplysningene som behandles eller resultatet av behandlingen. Når det gjelder innhenting av tredjepartsdata, skal Finterai heller ikke ha tilgang på denne typen personopplysninger men de vil få tilgang på modellene som er utviklet ved hjelp av personopplysningene.

Disse modellene skal også være tilgjengelig for alle bankene som deltar i den fødererte læringen. Man kan argumentere for at jo bedre disse modellene er, jo mer attraktiv vil Finterai sin tjeneste trolig være. Bankenes tilgang på modeller som er gode og effektive i anti-hvitvaskingsarbeid, kan derfor tenkes å fremme salget av Finterais tjeneste, og de vil derfor få en kommersiell fordel. Formålet med utvelgelsen av hvilke data-kategorier som skal inkluderes i tjenesten, er imidlertid at bankene skal kunne bygge effektive KI-modeller for å oppfylle sine forpliktelser etter hvitvaskingsreglene.

En ren kommersiell fordel som Finterai kunne tenkes å få her, er ifølge Personvernrådets retningslinjer ikke i seg selv nok til å kvalifisere som et formål til en behandling. Dette trekker derfor i retning av at Finterai ikke har avgjørende innflytelse på formålene nevnt ovenfor, og behandlingsansvar vil trolig ikke utløses for Finterai.

Les Personvernrådets retningslinjer om rollene som behandlingsansvarlig og databehandler (07/2020)

Det er også viktig å vurdere om man har et rettslig grunnlag for å innhente og bruke tredjepartsdata på denne måten før dataene innhentes og brukes. Selv om rettslig grunnlag ikke er tatt opp som tema i denne rapporten, vil vi likevel minne leseren om dette. Dataminimeringsprinsippet må også vurderes for innhenting og bruk av tredjepartsopplysninger, noe som blir drøftet nedenfor i kapitlet om dataminimering.

3. Kontroll av sårbarheter i modellene

Den siste behandlingsaktiviteten vi diskuterte, er knyttet til kontroller som skal utføres av Finterai i forbindelse med gjennomføring av den fødererte læringen.

Modellene som utveksles mellom bankene og Finterai, skal i utgangspunktet ikke inneholde personopplysninger. Det er likevel en viss risiko for at man kan hente ut personopplysningene som en modell er trent på, dersom modellen har sårbarheter. Dette er omtalt som datalekkasje, og innebærer at det er mulig å reidentifisere enkeltindivider. Slike sårbarheter kan oppstå dersom det har skjedd en feil under treningen.

Finterai planlegger å gjennomføre ulike typer kontroller på modellene som skal trenes ved bruk av føderert læring. Én kontroll som alle modellene må gjennom etter treningen og før de deles videre til andre deltakere, skal avdekke eventuell sannsynlighet for datalekkasje fra modellen. Dersom kontrollen hos Finterai avdekker sårbarheter som kan føre til datalekkasje, vil behandling av den aktuelle modellen kunne være å anse som behandling av personopplysninger.

Det er grunn til å anta at slike feil vil oppstå fra tid til annen, og et spørsmål som dukket opp i sandkassen var hvilken rolle Finterai får dersom de i praksis ender opp med å behandle personopplysninger på grunn av feil fra bankene.

Formålet med sårbarhetskontrollene er å forhindre at modeller som inneholder personopplysninger skal slippe inn i systemet for føderert læring. Man kunne tenke seg at den enkelte bank selv gjorde denne kontrollen før de sendte modellen til Finterai. Det er imidlertid gode grunner som taler for at denne kontrollen bør ligge hos Finterai, blant annet for å unngå at kvaliteten på kontrollen er avhengig av kompetansen i den enkelte bank.

Finterai har opplyst at eventuelle modeller med sårbarheter blir slettet, og beskjed blir sendt til den aktuelle banken som modellen kom fra. Ved å kontrollere modellene for svakheter, og luke ut modeller med feil, bistår Finterai bankene med å forhindre at personopplysninger kommer på avveie.

På bakgrunn av ovennevnte anser vi det lite sannsynlig at Finterai blir behandlingsansvarlig for eventuelle personopplysninger som avdekkes i kontrollen de gjennomfører. Kontrollen må trolig sies å skje på vegne av banken som modellen sist ble trent hos, og Finterai fremstår som databehandler for bankene i den grad personopplysninger behandles som del av kontrollen. Det vil være naturlig å innta retningslinjer i databehandleravtalen om hvilke tiltak Finterai og bankene skal gjennomføre dersom en feil oppstår og Finterai får tilgang til personopplysninger.

For modeller som ikke inneholder personopplysninger, vil hverken kontrollene som gjennomføres eller den videre utvekslingen av modellene, være behandlinger i personvernforordningens forstand, siden personopplysninger ikke behandles. Personvernregelverket kommer derfor ikke til anvendelse i slike tilfeller. Hvis det er noen tvil om hvorvidt modellen inneholder personopplysninger eller ikke, bør den behandles som om den inneholder personopplysninger og at personvernregelverket kommer til anvendelse.